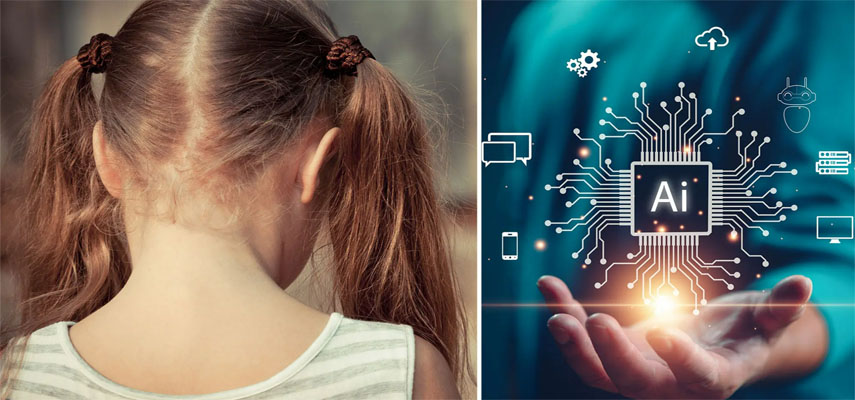

Фото обнаженных девочек, созданные с помощью искусственного интеллекта, распространились по Испании

Несколько несовершеннолетних были арестованы в Бадахосе на западе Испании, им грозит до 9 лет тюремного заключения.

В наш век Интернета у родителей более чем достаточно забот, и для более чем 20 матерей в городе Альмендралехо (Бадахос) на севере Испании на этой неделе сбылись худшие кошмары, касающиеся их детей.

В социальных сетях были размещены десятки фотографий их дочерей в возрасте от 12 до 17 лет, на которых девочки изображены обнаженными. И хотя лица вполне реальны, тела — нет, поскольку головы детей были наложены на изображения обнаженной натуры с помощью искусственного интеллекта.

Ситуацию осветила известный гинеколог Мириам Аль Адиб, которая подняла этот вопрос в Instagram, когда поняла, что фейковые фотографии ее девочек 14 и 17 лет распространились повсюду.

«Вы не осознаете, какой ущерб вы нанесли всем девочкам. И вы также не осознаете, какое это преступление. Это преступление, и очень серьезное», — предупредила обеспокоенная мать преступников, призвав все пострадавшие семьи высказаться.

На данный момент полиция Бадахоса приняла показания в отношении 23 пострадавших детей, и несколько подозреваемых были арестованы.

По словам г-жи Аль-Адиб, события начались в детской группе WhatsApp, но эксперты по правовым вопросам гендерного насилия и интернет-права сходятся во мнении, что независимо от возраста виновных, создание и распространение фотографий представляет собой преступление, связанное с детской порнографией.

Матери полагают, что многие из тех, кто стоит за насилием, являются учениками местной средней школы, но личности подозреваемых не разглашаются.

«Подана жалоба, взято несколько показаний, в частности семь заявлений взято у семи возможных потерпевших, и в результате полицейского расследования установлены личности некоторых несовершеннолетних, которые могли быть причастны», — подтвердил представитель полиции.

Искусственный интеллект вызывает растущую обеспокоенность во всем мире, поскольку эту технологию можно использовать в злонамеренных целях, таких как создание так называемых «дипфейков» — компьютерных, часто реалистичных изображений и видео, основанных на реальном шаблоне.

По данным исследования, проведенного в 2019 году голландской компанией Sensity, занимающейся искусственным интеллектом, около 96 процентов дипфейковых видео в Интернете представляют собой порнографию, полученную без согласия, и в большинстве из них изображены женщины.

Предыдущая